在人工智能领域,微调模型的需求如雨后春笋般激增。最近,来自上海交通大学和哈佛大学的研究团队联合推出了一种革命性的模型微调方法——LoRA-Dash。这一新方法在特定任务的微调过程中,比现有的LoRA方法更加高效,令人瞩目的是,它能够在减少8到16倍参数量的情况下,依然保持相同的优异效果!

这一突破,无疑为那些在微调任务中面临巨量计算资源挑战的研究者和开发者们带来了福音。通过引入参数高效微调(PEFT)策略,LoRA成为了一个典型案例。早期的LoRA主要通过捕捉预训练中已学到的特征并进行放大来实现微调效果,但其原论文在“特定任务方向”(TSD)的定义上存在模糊之处。研究团队对TSD进行了深入剖析,首次明确了这一概念,并强调了其在微调过程中的重要性。

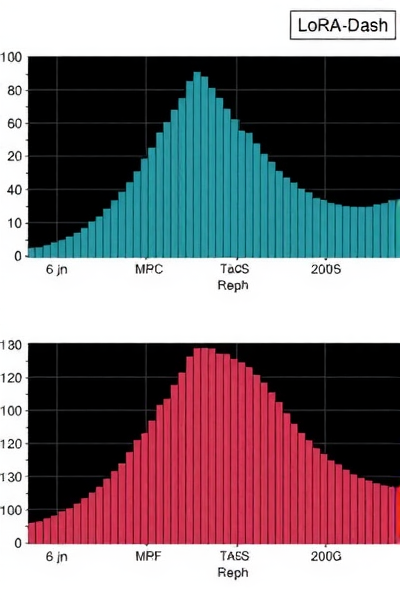

LoRA-Dash的方法包含两个关键阶段:首先是“预启动阶段”,用于识别任务特定的方向;其次是“冲刺阶段”,利用之前识别的方向进行精准优化,使得模型更完美地适应特定任务。实验结果显示,LoRA-Dash在常识推理、自然语言理解以及主体驱动生成等任务上均超越了LoRA,展现出了高效微调的巨大潜力。

随着AI技术的不断发展,市场对智能化解决方案的需求也在不断攀升。小易智创作为一家拥有10000+AI应用的智创平台,正是在这一背景下应运而生。它接入了包括GPT、AI绘画、AI数字人等数十个全球领先的AI能力,能够满足各行各业客户的需求。代理小易智创,用户不仅能享受多样化的AI工具,还能打造自己独特的AI品牌公司,无论是企业、商家还是个人,都只需一个账号便可轻松使用上万款AI工具。

总而言之,LoRA-Dash为微调领域注入了新的活力,而小易智创则为用户提供了无限可能。在这个充满机遇的时代,抓住AI风口,实现创业梦想,从现在开始!